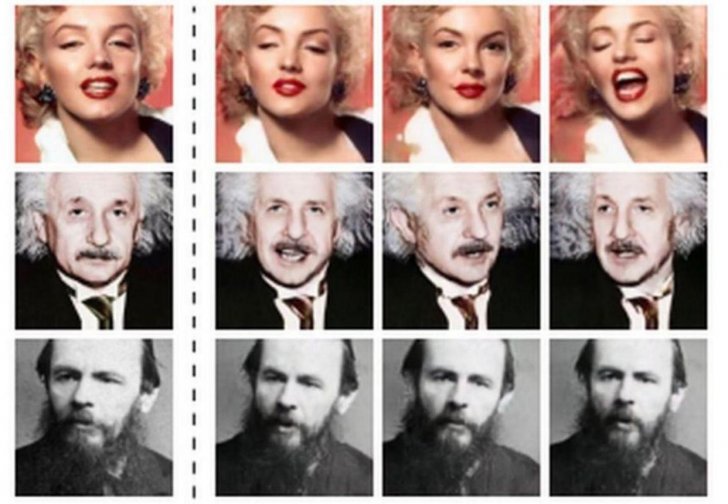

يوجد على شبكة الإنترنت، العديد من مقاطع الفيديو التي تُظهر قيام عدد من الأشخاص خاصة المشاهير، يقولون أو يفعلون أشياء غير حقيقية لم يقوموا بها بالفعل، فرغم أن هذه الفيديوهات تضم أناس حقيقيون ووجوه حقيقية، على مقربة من لقطات واقعية، إلا أن الأحداث غير حقيقية، وتسمى هذه المقاطع "deepfakes"، والتي يتم تصميمها باستخدام نوع معين من الذكاء الاصطناعي.

وهناك سوق مزدهرة على الإنترنت لوجوه المشاهير التي يتم وضعها على أجساد ممثلي الإباحية، ولكن السبب في الخوف من "Deepfakes" أكبر من ذلك، فإن الناس قلقون بشأن تأثيرها على الحياة بشكل عام والنقاشات السياسية، فهذه المخاوف حقيقية بما يكفي لدفع الحكومة البريطانية والكونغرس الأميركي إلى النظر في سبل تنظيمها.

كما تقول أستاذ القانون والأخلاق في منظمة العفو الدولية في معهد أكسفورد للإنترنت، ساندرا واتشر، أن أي تقنية تتطور بسرعة كبيرة يمكن أن يكون لها عواقب غير متوقعة وغير مقصودة، مضيفة "ليست مقاطع الفيديو المزيفة أو المعلومات الخاطئة جديدة، ولكن الأمور تتغير بسرعة كبيرة، مما يشكل تحديًا لقدرتنا على الاستمرار".

وأضافت واتشر أن الطريقة المعقدة التي يمكن بها إنشاء معلومات مزيفة، ومدى سرعة إنشائها، وكيف يمكن نشرها إلى ما لا نهاية أصبحت فى مستوى مختلف من ذى قبل، حيث كانت أصعب وأقل انتشارا.

وتعد هذه التقنية نتاج خوارزميات الذكاء الاصطناعي، لذلك تشمل الحلول التكنولوجية للتغلب عليها على سبيل المثال هي إعطاء ملف فيديو سلسلة قصيرة من الأرقام التي يتم فقدها إذا تم التلاعب به، أو أن تسجل الشخصيات العامة باستمرار مكانها وما الذي يقومون به، بحيث إذا ما تم تعميم تطبيق "deepfake" على ما أمر لا يقومون به، فيمكنهم إظهار ما كانوا يقومون به حقًا.

ولكن لا يمكن لأي من هذه الحلول أن يزيل بالكامل مخاطر حدوث هذا التلاعب، لذلك هناك ضرورة لوجود نوع من الإطار التنظيمي.